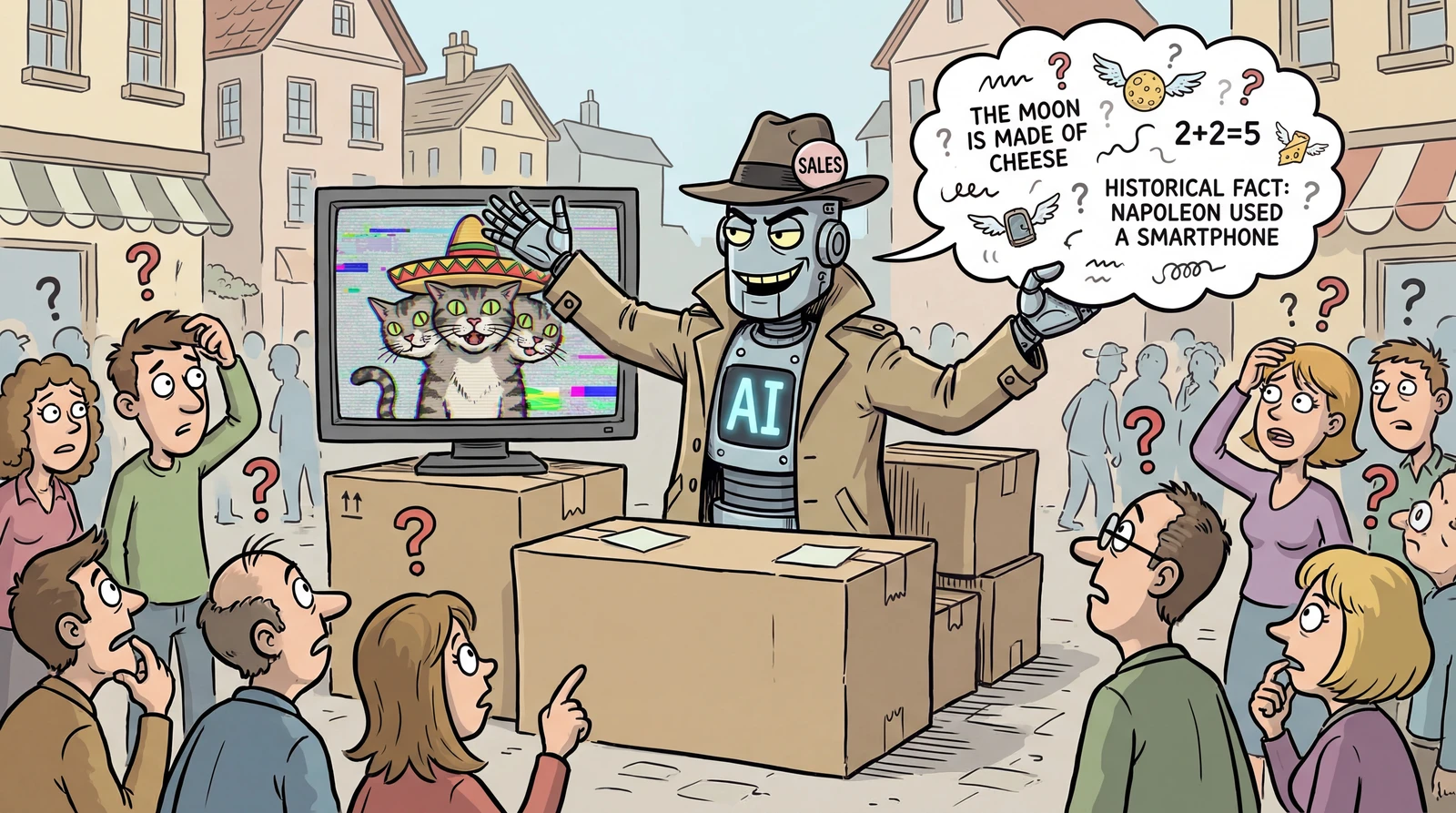

AI는 왜 자신 있게 거짓말을 할까?

AI에게 질문했는데, 존재하지 않는 정보를 인용하거나 없는 사실을 자신 있게 말한 적 없으신가요?

이것이 바로 AI 할루시네이션입니다.

이 글에서는 할루시네이션이 무엇인지, 왜 일어나는지, 2026년 현재 얼마나 개선되었는지, 그리고 어떻게 대처할 수 있는지를 함께 알아봅시다.

list목차expand_more

- 1. 할루시네이션이란?

- 대표적인 할루시네이션 유형

- 2. 왜 할루시네이션이 일어날까?

- ① AI는 “진실”을 모른다

- ② 학습한 내용 자체가 불완전하다

- ③ 질문이 애매하면, AI는 “대충 때운다”

- ④ “모르겠다”고 말하도록 훈련되지 않았다

- ⑤ 말은 잘하지만, 내용은 틀릴 수 있다

- ⑥ 대화가 길어지면 더 틀리기 쉽다

- 3. 2026년 최신 AI 모델별 할루시네이션 수준

- 3-1. Vectara 할루시네이션 리더보드

- 3-2. 그 외 평가 결과

- 4. 할루시네이션을 줄이는 방법

- ① 구체적으로 질문하기

- ② 참고 자료를 직접 넣어주기

- ③ “모르면 모른다고 해”라고 말하기

- ④ 한 번에 다 묻지 말고, 나눠서 질문하기

- ⑤ AI 답변을 그대로 믿지 않기

- 5. 앞으로의 전망

- 5-1. 꽤 많이 좋아지고 있다

- 5-2. 하지만 “완벽”을 기대하긴 이르다

- 6. 오늘 배운 내용 정리

- 7. 참고 자료

1. 할루시네이션이란?

AI가 “환각(Hallucination)”을 본다는 비유에서 온 용어입니다.

사람의 환각이 실제로 없는 것을 보는 것처럼, AI도 실제로 존재하지 않는 정보를 마치 사실인 것처럼 생성합니다.

대표적인 할루시네이션 유형

-

없는 정보 지어내기 : “이 맛집은 미슐랭 2스타입니다”라고 자신 있게 말하지만, 실제로는 미슐랭에 등재된 적 없는 식당

-

사실 뒤섞기 : “이 영화는 2022년 개봉해서 아카데미 작품상을 받았어요”라고 하지만, 개봉 연도나 수상 내역이 틀림

-

엉뚱한 추천 : “이 약은 두통에 효과적입니다”라고 했지만, 실제로는 전혀 다른 용도의 약

-

이미지 오류 : AI가 만든 이미지에서 손가락이 6개이거나, 간판 글자가 이상하게 깨지는 현상

WARNING

2025년 1월, 미국 미네소타 연방법원에서 기묘한 판결이 나왔습니다.

“AI와 허위정보의 위험성”을 주제로 한 전문가 보고서가 법원에 제출됐는데, 판사가 확인해보니 보고서에 인용된 논문들이 전부 존재하지 않았죠. ChatGPT가 만들어낸 가짜 논문들이었습니다. 법원은 해당 제출물을 기각했고, 판결문에 한 마디를 남겼습니다.

“The irony.”

이처럼 AI는 “잘 모르겠어요”라고 말하는 대신, 그럴듯한 답을 만들어내는 경향이 있습니다.

2. 왜 할루시네이션이 일어날까?

AI가 “거짓말”을 하는 이유를 이해하려면, 먼저 AI가 어떻게 작동하는지 알아야 합니다.

① AI는 “진실”을 모른다

앵무새는 사람의 말을 듣고 똑같이 따라합니다. 발음도 정확하고, 억양도 자연스럽습니다. 하지만 앵무새는 자기가 하는 말의 뜻을 이해하지 못합니다. AI도 마찬가지입니다.

AI는 인터넷에 있는 엄청난 양의 글을 보고 “이런 말 다음에는 이런 말이 자주 나오더라”라는 패턴을 배운 것입니다. 예를 들어 “한국의 수도는?”이라고 물으면, 수많은 글에서 “한국”, “수도” 다음에 “서울”이 자주 나왔으니까 “서울”이라고 대답합니다.

이 방식은 자주 쓰이는 지식일수록 놀라울 만큼 정확합니다.

하지만 핵심은, AI가 사실 여부를 확인해서 답하는 것이 아니라, 패턴의 통계적 확률에 따라 답하는 것이라는 점이죠. 그래서 학습 데이터가 부족한 주제나 복잡한 질문에서는 그럴듯하지만 틀린 답을 만들어내게 됩니다.

② 학습한 내용 자체가 불완전하다

AI는 인터넷의 글들을 보고 배웁니다. 그런데 인터넷에는

-

정확한 뉴스 기사도 있지만, 틀린 블로그 글도 있고

-

전문가의 설명도 있지만, 근거 없는 후기나 소문도 있습니다

AI는 이 모든 것을 구분 없이 학습합니다. 마치 도서관에서 검증된 전문 서적과 누군가 끼워넣은 엉터리 책을 구별 없이 읽은 것과 비슷하죠.

③ 질문이 애매하면, AI는 “대충 때운다”

“맛있는 거 추천해줘”라고 물으면, AI는 여러분이 어디에 사는지, 어떤 음식을 좋아하는지, 예산이 얼마인지 모릅니다. 그냥 빈 곳을 가장 그럴듯한 내용으로 채워넣습니다. 이것이 할루시네이션의 가장 흔한 원인입니다.

④ “모르겠다”고 말하도록 훈련되지 않았다

AI는 개발 과정에서 “좋은 답변을 해야 높은 점수를 받는” 방식으로 학습됩니다.

그래서 모르는 것도 어떻게든 답하려는 성향이 있습니다. 사람으로 치면, 시험에서 빈칸을 남기기 싫어서 아무거나 적는 것과 비슷합니다.

⑤ 말은 잘하지만, 내용은 틀릴 수 있다

AI는 자연스럽고 자신감 넘치는 문장을 만들도록 훈련됩니다.

문제는, 틀린 내용도 매우 유창하게 말한다는 것입니다. 사람도 자신 있게 말하는 사람을 더 신뢰하잖아요? AI도 마찬가지로, 틀린 답을 확신에 차서 말하기 때문에 속기 쉽습니다.

⑥ 대화가 길어지면 더 틀리기 쉽다

AI와 오래 대화할수록 할루시네이션이 늘어나는 것을 느끼셨을 수도 있습니다. 이건 우연이 아니라 AI의 구조적인 이유가 있습니다.

-

앞의 대화를 잊는다 : 대화가 길어지면 AI의 “기억 용량”이 가득 차서, 처음에 말했던 조건이나 맥락을 놓치기 시작합니다. 마치 2시간짜리 회의에서 처음에 한 이야기를 끝에 가서 잊는 것과 같습니다.

-

작은 실수가 눈덩이처럼 커진다 : 대화 초반에 AI가 살짝 틀린 정보를 말했는데, 뒤에서 그 틀린 정보를 기반으로 계속 답변하면 오류가 점점 쌓입니다.

-

집중력이 분산된다 : AI는 대화의 모든 내용에 “주의(Attention)”를 나눠야 합니다. 대화가 길어질수록 각 부분에 쏟을 수 있는 주의력이 줄어들어, 중요한 맥락을 놓치고 엉뚱한 방향으로 답변할 확률이 높아집니다.

NOTE

대화가 길어졌다고 느끼면, 새로운 대화창을 열고 핵심 내용을 다시 정리해서 시작하세요. 이것만으로도 할루시네이션을 크게 줄일 수 있습니다.

3. 2026년 최신 AI 모델별 할루시네이션 수준

할루시네이션은 측정 방법에 따라 수치가 크게 달라집니다.

3-1. Vectara 할루시네이션 리더보드

주어진 문서를 요약할 때, 원문에 없는 내용을 얼마나 만들어내는지를 측정합니다.

| AI 모델 | 할루시네이션 비율 |

|---|---|

| Google / Gemini 2.5 Flash Lite | 3.3% |

| OpenAI / GPT 4.1 | 5.6% |

| xAI / Grok 3 | 5.8% |

| OpenAI / GPT 5.4 | 7% |

| Google / Gemini 2.5 Pro | 7% |

| Google / Gemini 2.5 Flash | 7.8% |

| Google / Gemini 3.1 Flash Lite | 8.2% |

| OpenAI / GPT 4o | 9.6% |

| Anthropic / Claude Sonnet 4 | 10.3% |

| Google / Gemini 3.1 Pro | 10.4% |

3-2. 그 외 평가 결과

위의 Vectara 리더보드는 “문서 요약” 작업 기준이라 할루시네이션이 낮게 나옵니다. 하지만 자유로운 질문/응답 상황에서는 결과가 매우 다릅니다.

-

AIMultiple 벤치마크: 37개 AI 모델에게 60개의 테스트 질문을 했을 때, 최신 모델도 15% 이상의 할루시네이션. 법률 질문은 약 18.7%, 의료 질문은 약 15.6% 오류

-

AA-Omniscience 벤치마크: 난이도 높은 지식 질문에서, 테스트된 모델 중 대부분의 AI가 정답보다 할루시네이션을 더 자주 생성

4. 할루시네이션을 줄이는 방법

할루시네이션을 완전히 없앨 수는 없지만, 크게 줄일 수 있는 방법들이 있습니다.

① 구체적으로 질문하기

-

나쁜 예 : “도쿄 여행 알려줘”

-

좋은 예 : “4월 초에 도쿄 3박 4일 여행 가는데, 벚꽃 명소 위주로 일정 짜줘. 예산은 1인 100만 원이야.”

질문이 구체적일수록 AI가 만들어낼 여지가 줄어듭니다.

② 참고 자료를 직접 넣어주기

AI에게 답변의 재료를 직접 줄 수 있습니다. 예를 들어:

“이 기사 내용만으로 요약해줘” (기사 URL이나 텍스트를 함께 붙여넣기)

이렇게 하면 AI가 스스로 정보를 지어내는 것을 크게 줄일 수 있습니다.

③ “모르면 모른다고 해”라고 말하기

“확실하지 않은 내용은 ‘확인 필요’라고 표시하고 출처를 알려줘”

이 한마디를 추가하면, AI가 억지로 답을 만들어내는 대신 출처와 함께 솔직하게 알려줄 확률이 높아집니다.

④ 한 번에 다 묻지 말고, 나눠서 질문하기

복잡한 질문을 한꺼번에 던지면 오류가 생기기 쉽습니다. 단계를 나누면 중간중간 잘못된 부분을 잡을 수 있습니다.

⑤ AI 답변을 그대로 믿지 않기

AI가 말해준 맛집, 약 정보, 역사적 사실 등 중요한 내용은 반드시 구글 검색이나 공식 사이트에서 한 번 더 확인하세요.

5. 앞으로의 전망

5-1. 꽤 많이 좋아지고 있다

AI의 할루시네이션은 분명히 줄어들고 있습니다.

-

“이 문서 요약해줘” 같은 작업에서는 할루시네이션이 1% 미만까지 떨어졌습니다. AI에게 참고할 자료를 직접 주면, 지어내는 일이 거의 없어진 거죠.

-

AI 모델이 세대를 거듭할수록 정확도가 올라가는 추세이고, 2025년 말~2026년 초에 나온 GPT-5.2, Opus 4.5 같은 최신 모델은 눈에 띄게 나아졌습니다.

5-2. 하지만 “완벽”을 기대하긴 이르다

솔직히 말하면, 할루시네이션을 완전히 없애는 것은 아직 불가능합니다.

AI가 “다음에 올 단어를 예측하는” 방식으로 작동하는 한, 가끔 틀리는 건 이 기술의 본질적인 특성이기 때문입니다.

-

일부 전문가는 2027년쯤이면 “대부분의 상황에서 신경 쓰지 않아도 될 수준”이 될 거라고 봅니다.

-

반대로 어떤 연구자는 “2023년에도 곧 해결된다고 했는데, 아직도 완전하지 않다”며 과도한 기대를 경계합니다.

그래서 현실적인 목표는 “완전 제거”가 아니라 “충분히 줄이기”입니다.

AI는 유능한 동료지만, 사람처럼 가끔 실수도 합니다. 그 점을 꼭 이해하고 사용하세요.

6. 오늘 배운 내용 정리

-

AI는 “안다”가 아니라 “예측한다” : 자신감 넘치는 답변이 정확한 답변은 아닙니다

-

상황에 따라 신뢰도가 다르다 : 문서 요약은 1% 미만, 자유 질문은 15% 이상 오류

-

구체적으로 질문하고, 근거를 제공하고, 교차 검증하라 : 사용자의 습관이 가장 강력한 방어막

-

AI는 동료이지, 오라클이 아니다 : 최종 판단은 항상 사람의 몫

7. 참고 자료

-

Short Circuit Court: AI Hallucinations in Legal Filings and How To Avoid Making Headlines: https://www.coleschotz.com/news-and-publications/short-circuit-court-ai-hallucinations-in-legal-filings-and-how-to-avoid-making-headlines/

-

Vectara Hallucination Leaderboard : huggingface.co/spaces/vectara/leaderboard

-

AIMultiple, AI Hallucination: Compare top LLMs (2026.01) : aimultiple.com/ai-hallucination

-

Artificial Analysis, AA-Omniscience Knowledge & Hallucination Benchmark : artificialanalysis.ai/articles/aa-omniscience-knowledge-hallucination-benchmark

-

Suprmind, AI Hallucination Rates & Benchmarks in 2026 : suprmind.ai/hub/ai-hallucination-rates-and-benchmarks

-

Suprmind, AI Hallucination Statistics: Research Report 2026 : suprmind.ai/hub/insights/ai-hallucination-statistics-research-report-2026