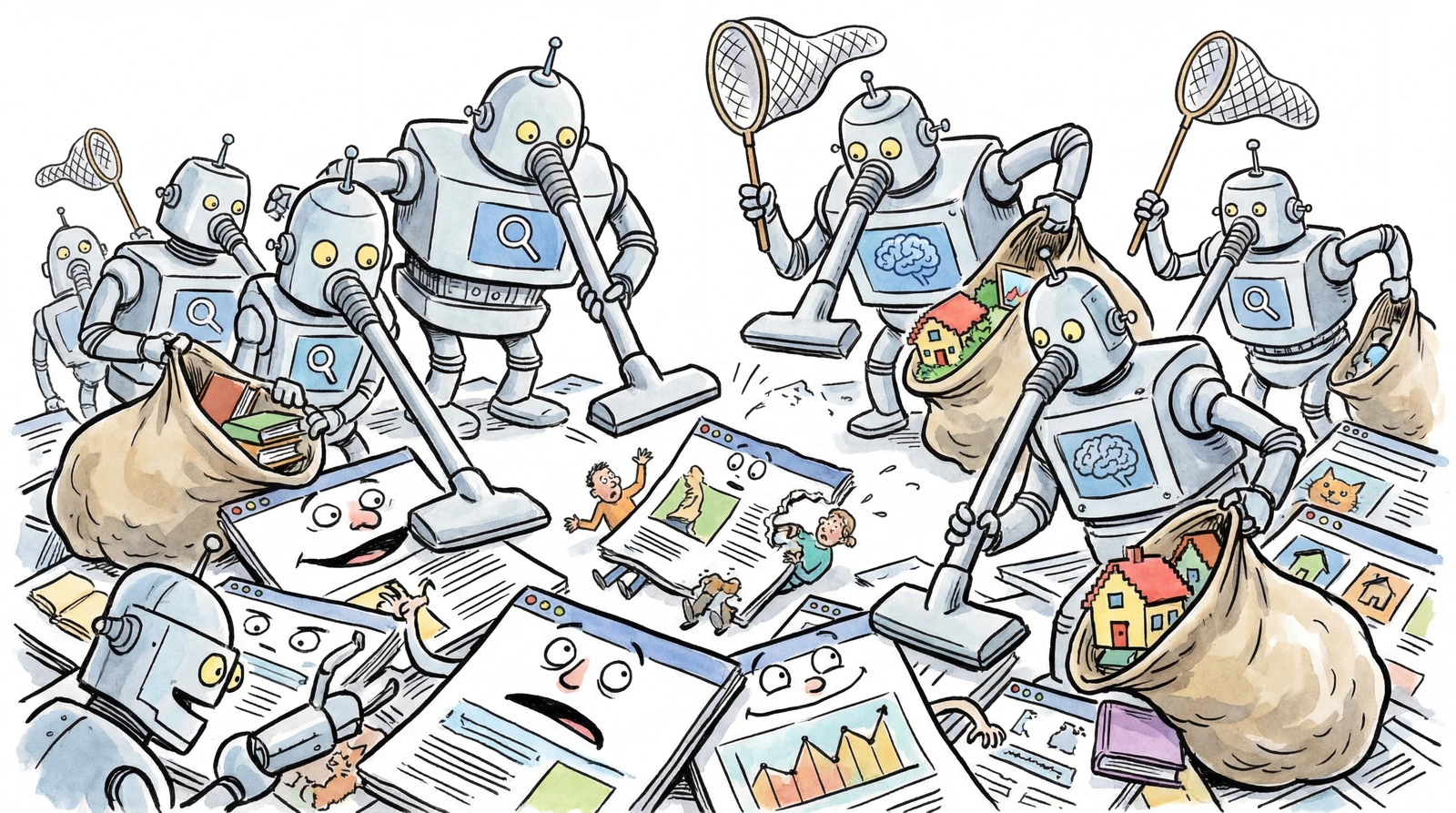

내가 모르는 사이에, AI가 내 웹사이트 글을 읽어가고 있다면?

Google에서 검색하면 웹사이트가 나오죠?

그건 Google이 자동 프로그램(=봇)을 보내 웹사이트의 정보를 미리 읽어갔기 때문입니다.

이렇게 봇이 웹사이트를 돌아다니며 내용을 수집하는 과정을 크롤링(Crawling)이라고 합니다.

그런데 요즘은 검색엔진뿐 아니라, ChatGPT·Gemini·Claude 같은 AI까지 웹사이트를 방문해, 내 동의도 없이 콘텐츠를 가져가고 있습니다.

이 가이드에서는 크롤링이 뭔지부터, 이를 컨트롤하는 3가지 방법, 그리고 반대로 AI가 내 콘텐츠를 인용하도록 만드는 GEO 전략까지 함께 알아봅시다.

list목차expand_more

- 1. 크롤링이란?

- 1-1. 검색엔진의 크롤링 원리

- 1-2. AI 봇의 크롤링, 무엇이 다른가?

- 2. 크롤링 제어의 3가지 도구

- 2-1. robots.txt: 출입 규칙

- 2-2. ai.txt: AI 사용 안내문

- 2-3. llms.txt: AI를 위한 사이트 안내서

- 3. 세 파일의 역할 비교

- 4. 이 규칙, 정말 지켜질까?

- 4-1. 누가 지키고, 누가 무시하는가?

- 4-2. 법적 보호 장치는 어디까지 왔나?

- 4-3. 그렇다면 어떻게 대비해야 하나?

- 5. 내 사이트, AI에게 이미 털렸을까? 확인하는 5가지 방법

- ① 서버 로그(Access Log) 분석

- ② AI에게 직접 물어보기

- ③ 온라인 크롤러 접근 검사 도구

- ④ 공개 학습 데이터셋에서 내 사이트 검색

- ⑤ 행동 기반 봇 탐지

- 6. 실전 체크리스트

- Step 1: AI 사용 원칙 정리

- Step 2: ai.txt 작성 및 업로드

- Step 3: llms.txt 작성 및 업로드

- Step 4: 정기 업데이트 프로세스

- 7. GEO(Generative Engine Optimization) 기초

- 7-1. GEO란?

- 7-2. SEO vs GEO 핵심 차이

- 7-3. AI가 “좋은 콘텐츠”를 판단하는 기준

- 7-4. GEO 핵심 전략

- 오늘의 요약

1. 크롤링이란?

크롤링(Crawling)은 검색엔진이나 AI 봇이 웹사이트를 자동으로 방문하여 페이지 내용을 읽고 저장하는 과정입니다.

NOTE

왜 크롤링이 필요할까?

웹사이트를 만들었다고 해서 자동으로 Google에 나타나는 것이 아닙니다.

비유하자면, 크롤링은 도서관 사서가 새 책을 찾아다니는 과정과 비슷해요.

- 세상에 수십억 개의 웹페이지가 있지만, 검색엔진은 그 존재를 저절로 알 수 없습니다.

- 그래서 검색엔진은 크롤러 혹은 봇(Bot)이라는 자동 프로그램을 보내 웹사이트를 방문하고 내용을 읽어갑니다.

- 읽어간 내용을 도서관의 목록 카드처럼 색인(Index)에 저장합니다.

- 누군가 검색하면, 색인에 저장된 페이지 중 가장 관련 있는 것을 골라 보여줍니다.

즉, 검색엔진에 크롤링되지 않은 페이지 = 도서관 목록에 없는 책 = 아무도 찾을 수 없는 페이지입니다.

1-1. 검색엔진의 크롤링 원리

-

발견(Discovery): 검색엔진 봇(Googlebot 등)이 링크를 따라 새로운 페이지를 발견

-

수집(Crawling): 페이지의 HTML, 텍스트, 이미지 등 콘텐츠를 읽어감

-

색인(Indexing): 수집된 내용을 분석·저장하여 검색 가능한 상태로 만듦

-

노출(Ranking): 사용자가 검색하면 관련성·신뢰도에 따라 순위를 매겨 결과에 표시

1-2. AI 봇의 크롤링, 무엇이 다른가?

ChatGPT, Gemini, Perplexity 같은 생성형 AI는 기존 검색엔진과 다른 방식으로 웹 콘텐츠를 활용합니다.

| 구분 | 검색엔진 | 생성형 AI |

|---|---|---|

| 목적 | 페이지를 색인 → 링크 목록으로 제공 | 콘텐츠를 학습·요약 → 직접 답변 생성 |

| 사용자 행동 | 검색 결과 클릭 → 사이트 방문 | AI 답변으로 해결 → 사이트 미방문 가능 |

| 봇 종류 | Googlebot, Bingbot 등 | GPTBot, ClaudeBot, Google-Extended 등 |

| 방문 빈도 | 꾸준함 | 해마다 빠르게 늘고 있음 |

NOTE

KNOW ー 이걸 왜 알아야하나요?

이제 웹사이트 운영자는 “내 콘텐츠를 AI가 학습용으로 써도 되는가?”라는 질문에 답해야 합니다.

EU는 이미 저작권자가 “내 콘텐츠를 AI 학습에 쓰지 마세요”라고 거부할 수 있는 권리를 법으로 보장하기 시작했고, 이 흐름은 전 세계로 확산되고 있습니다.

2. 크롤링 제어의 3가지 도구

2-1. robots.txt: 출입 규칙

-

위치:

https://내도메인/robots.txt -

대상: 검색엔진, 일반 크롤러, 일부 AI 봇

-

역할: “누가 어디까지 들어와도 되는지” 정하는 출입 규칙

-

표준화: 오래된 웹 표준. 가장 널리 쓰임

기본 문법:

User-agent: * # 모든 크롤러에 적용

Allow: /blog/ # /blog/ 경로 크롤링 허용

Disallow: /admin/ # /admin/ 경로 크롤링 차단

User-agent: GPTBot # OpenAI 봇만 별도 제어

Disallow: / # GPTBot 전체 차단

Sitemap: https://example.com/sitemap.xml

핵심 포인트:

-

AI 봇별로 개별 제어 가능 (GPTBot, ClaudeBot, Google-Extended 등)

-

Disallow: /→ 해당 봇의 전체 크롤링 차단 -

Allow: /→ 전체 허용 -

가장 기본이 되는 크롤링 제어 수단

2-2. ai.txt: AI 사용 안내문

-

위치:

https://내도메인/ai.txt -

대상: AI 크롤러, AI 에이전트

-

역할: “AI가 우리 콘텐츠를 어떤 용도와 범위까지 써도 되는지” 설명

-

표준화: 아직 공식 표준이 아닌 제안·실험 단계

ai.txt로 제어할 수 있는 것:

- 허용/차단 범위

- 공개 블로그, 도움말 → AI 요약·검색·답변 생성에 활용 허용

- 유료 강의, 회원 전용 콘텐츠 → AI 학습·요약 금지

- 우선 참고 데이터 경로

Sitemap,Data-Format,API-Search등으로 AI가 효율적으로 읽을 수 있는 경로 안내

- 정책(Policy) 문장

- 사람이 읽어도 이해되는 AI 사용 원칙 (법무·브랜드 기준)

작성 예시:

# ai.txt for example.com

# Last-Updated: 2026-03-26

User-Agent: *

Allow: /blog/

Allow: /docs/

Allow: /help/

Disallow: /members/

Disallow: /billing/

Sitemap: https://example.com/sitemap.xml

# Policy:

# - Public blog, docs, and help center pages MAY be used for

# indexing, search, summarization, and Q&A answering.

# - Member-only pages and user data MUST NOT be used for

# model training or AI-generated answers.

ai.txt가 특히 중요한 사이트:

-

유료·전문 콘텐츠가 많은 사이트 (강의, 리포트 등)

-

회원이 글을 많이 쓰는 커뮤니티형 서비스

-

법무·정책 리스크가 큰 서비스 (금융, 의료, 교육, 공공)

2-3. llms.txt: AI를 위한 사이트 안내서

-

위치:

https://내도메인/llms.txt -

대상: LLM(ChatGPT 등)이 답변 생성 시 참고

-

역할: “AI가 답변할 때 어떤 문서를 먼저 읽어야 하는지” 안내하는 요약·색인

-

형식: 마크다운

-

표준화: 데이터 사이언티스트 Jeremy Howard가 제안한 llmstxt.org 비공식 표준. 빠르게 확산 중

llms.txt의 구성:

-

#H1 제목 (사이트/서비스 이름) -

>Blockquote로 2~3줄 요약 -

일반 문단으로 서비스 설명

-

##섹션별로 핵심 문서 링크 리스트

작성 예시:

# KnowAI

> KnowAI is an AI education and consulting platform.

> This file helps LLMs find the most important resources

> and answer questions accurately.

Last-Updated: 2026-03-26

## Docs

- [Getting Started](https://knowai.com/docs/start): 서비스 개요와 시작 방법

- [Features](https://knowai.com/docs/features): 핵심 기능 설명

- [FAQ](https://knowai.com/docs/faq): 자주 묻는 질문

## Blog

- [All Articles](https://knowai.com/blog): AI 활용 팁과 트렌드

## Policies

- [Terms of Service](https://knowai.com/terms)

- [Privacy Policy](https://knowai.com/privacy)

llms.txt 작성 체크포인트:

-

H1 제목이 있는지

-

Blockquote 형식의 짧은 요약이 있는지

-

핵심 문서 링크가 리스트로 정리되어 있는지

-

모든 URL이 실제로 열리는지

3. 세 파일의 역할 비교

| 구분 | robots.txt | ai.txt | llms.txt |

|---|---|---|---|

| 비유 | 🚧 출입 규칙 | 📋 사용 안내문 | 📖 핵심 문서 안내서 |

| 주요 대상 | 검색엔진 봇, 일부 AI 봇 | AI 크롤러 전용 | LLM (답변 생성 시) |

| 목적 | 봇의 출입 허용/차단 | AI 학습·요약 용도와 범위 명시 | AI가 우선 참고할 문서 목록 제공 |

| 형식 | 텍스트, 규칙 기반 | 텍스트, 규칙 + 메타정보 | 마크다운 |

| 표준화 | ✅ 오래된 웹 표준 | ⚠️ 실험 단계 | ⚠️ 비공식 표준 (빠르게 확산) |

4. 이 규칙, 정말 지켜질까?

위 세 가지 파일은 모두 “자발적 준수”에 기반합니다. 즉, 기술적으로 접근을 막는 장치가 아니라, “우리 집 규칙은 이렇습니다”라고 써 붙이는 안내문에 가깝죠.

CAUTION

2025년 미국 법원(Ziff Davis v. OpenAI)은 robots.txt에 대해 이렇게 판결했습니다.

“robots.txt는 잔디밭에 세운 ‘출입금지’ 표지판과 같다. 접근을 실제로 통제하는 기술적 장치가 아니라, 방문자가 스스로 지키길 바라는 요청일 뿐이다.”

즉, AI 봇이 이 요청을 무시하더라도 현재 미국법상 해킹(DMCA 위반)으로 보기 어렵다는 것이 법원의 입장입니다.

4-1. 누가 지키고, 누가 무시하는가?

| 구분 | 대체로 준수 | 무시 사례 보고 |

|---|---|---|

| 주요 업체 | Googlebot, GPTBot(OpenAI), ClaudeBot(Anthropic) 등 대형 업체는 robots.txt를 대체로 존중 | 일부 AI 스타트업·소규모 크롤러는 robots.txt를 무시하고 무단 수집 |

| 문제점 | 공식 봇 이름을 사용해 식별 가능 | 봇 이름을 위장하거나 신원을 숨기는 크롤러가 존재해 차단 자체가 어려움 |

-

NPR(2024)은 “AI 크롤러가 인터넷의 기본 규칙을 무시하며 폭주하고 있다”고 보도

-

Cloudflare는 2024년 7월 “AI 스크래퍼 및 크롤러” 원클릭 차단 토글을 출시하여, robots.txt를 무시하는 봇도 기술적으로 차단할 수 있게 됨

4-2. 법적 보호 장치는 어디까지 왔나?

| 지역 | 현재 상황 |

|---|---|

| 🇪🇺 EU | DSM 지침 제4조: 저작권자가 robots.txt 등으로 “AI 학습에 쓰지 마세요”라고 명시적으로 거부하면 법적 효력 인정. EU AI Act(2024년 제정)에 따라 2025년 8월부터 GPAI(범용 AI) 제공자는 기계 판독 가능 형식의 옵트아웃(사후 거부) 의무적으로 준수해야 함 |

| 🇺🇸 미국 | 연방 통합법 없음. 법원은 robots.txt를 기술적 보호조치로 인정하지 않았으나, 저작권 침해·계약 위반 등 다른 법리로 소송 진행 중 (NYT v. OpenAI, Reddit v. Anthropic 등) |

| 🇰🇷 한국 | AI 기본법(2026.01 시행)에서 고위험 AI 규제·설명 의무 도입. 크롤링 자체에 대한 명시 규정은 아직 미비하나, 저작권법 위반 여부로 접근 가능 |

| 🇯🇵 일본 | 저작권법 제30조의4에서 AI 학습용 데이터 활용을 폭넓게 허용하되, “저작권자의 이익을 부당하게 해치는 경우”는 제외 |

4-3. 그렇다면 어떻게 대비해야 하나?

NOTE

실질적 보호 = 방어를 여러 겹 쌓는 것

- robots.txt + ai.txt + llms.txt: 최소한의 “의사 표시” (법적 분쟁 시 증거가 됨)

- 이용약관에 AI 크롤링 금지 명시: 계약 위반으로 법적 근거 확보

- WAF(웹 방화벽) 규칙: Cloudflare 등에서 AI 봇을 기술적으로 차단

- 로그 모니터링: 어떤 봇이 접근하는지 추적·기록

- 라이선싱 계약: 대형 AI 회사와 콘텐츠 사용 계약 체결 (Reddit-Google 사례)

robots.txt만으로는 부족합니다. 하지만 “아무것도 안 하는 것”과 “명확히 거부 의사를 표시한 것”은 법적으로 전혀 다른 위치에 놓입니다. 특히 EU에서는 이미 법적 효력이 인정되고 있습니다.

5. 내 사이트, AI에게 이미 털렸을까? 확인하는 5가지 방법

robots.txt로 “들어오지 마세요”라고 써 놓는 것은 미래의 크롤링을 막기 위한 것입니다. 그렇다면 이미 일어난 크롤링이나 학습은 어떻게 알 수 있을까요? 개인이나 소규모 팀도 할 수 있는 실질적인 확인 방법을 정리했습니다.

① 서버 로그(Access Log) 분석

-

난이도: ⭐⭐ (기본 서버 지식 필요)

-

비용: 무료

-

가장 기본적이면서도 확실한 방법입니다.

웹서버(Apache, Nginx 등)의 접근 로그에는 어떤 봇이, 언제, 어떤 페이지를 방문했는지 기록됩니다.

확인할 User-Agent 목록:

| 봇 이름 | 운영사 | 목적 |

|---|---|---|

GPTBot | OpenAI | 학습 데이터 수집 |

ChatGPT-User | OpenAI | 실시간 검색·브라우징 |

ClaudeBot | Anthropic | 학습 데이터 수집 |

Google-Extended | Gemini 학습용 | |

PerplexityBot | Perplexity | AI 검색·답변 생성 |

CCBot | Common Crawl | 오픈 데이터셋 (다수 AI 학습에 사용) |

Bytespider | ByteDance | 학습 데이터 수집 |

터미널에서 바로 확인하는 명령어:

# Nginx 로그에서 AI 봇 찾기

grep -iE “GPTBot|ClaudeBot|Google-Extended|PerplexityBot|CCBot|Bytespider|ChatGPT-User” /var/log/nginx/access.log

# 어떤 AI 봇이 몇 번 왔는지 집계

grep -ioE “GPTBot|ClaudeBot|Google-Extended|PerplexityBot|CCBot|Bytespider” /var/log/nginx/access.log | sort | uniq -c | sort -rn

NOTE

호스팅 업체(Vercel, Netlify 등)를 쓰는 경우, 대시보드의 Analytics나 Functions 로그에서 User-Agent를 필터링할 수 있습니다. Cloudflare를 쓰고 있다면 AI Audit 기능(무료)으로 AI 봇 트래픽을 시각적으로 확인 가능합니다.

② AI에게 직접 물어보기

-

난이도: ⭐ (누구나 가능)

-

비용: 무료

-

ChatGPT, Claude, Gemini, Perplexity 등에 내 사이트에 대해 구체적으로 질문해보면, 해당 AI가 내 콘텐츠를 알고 있는지 간접적으로 확인할 수 있습니다.

테스트 방법:

-

“knowai.com이라는 사이트에 대해 알고 있어?” 라고 물어봅니다

-

내 사이트에만 있는 고유한 표현이나 문장을 검색해봅니다

-

내 블로그 글의 핵심 내용을 요약해달라고 해봅니다

WARNING

NO ー AI가 내 콘텐츠를 “알고 있다”고 해서 반드시 직접 크롤링한 것은 아닙니다.

Common Crawl 같은 공개 데이터셋을 통해 간접적으로 학습했을 수 있고, 반대로 “모른다”고 해도 학습에 사용되지 않았다는 보장은 없습니다. 학습은 했지만 답변에 반영되지 않을 수 있기 때문입니다.

③ 온라인 크롤러 접근 검사 도구

-

난이도: ⭐ (누구나 가능)

-

비용: 무료

-

서버 로그에 접근할 수 없는 경우, 외부 도구로 내 사이트의 robots.txt 설정 상태와 AI 봇 접근 가능 여부를 확인할 수 있습니다.

추천 도구:

-

MRS Digital AI Crawler Access Checker: 도메인만 입력하면 GPTBot, ClaudeBot, PerplexityBot 등이 차단되어 있는지 즉시 확인

-

Cloudflare AI Audit (무료 플랜 포함): Cloudflare를 사용하는 사이트라면 어떤 AI 봇이 실제로 방문했는지, robots.txt를 준수했는지 대시보드에서 확인 가능

-

Cloudflare “AI 스크래퍼 및 크롤러” 원클릭 차단: 무료 플랜에서도 토글 하나로 모든 AI 봇을 차단할 수 있습니다

④ 공개 학습 데이터셋에서 내 사이트 검색

-

난이도: ⭐⭐ (검색 능력 필요)

-

비용: 무료

-

많은 AI 모델이 Common Crawl 같은 공개 데이터셋을 학습에 사용합니다. 내 사이트가 이 데이터셋에 포함되어 있다면, 높은 확률로 여러 AI 모델의 학습에 사용되었을 수 있습니다.

NOTE

Common Crawl이란?

2007년 Gil Elbaz가 설립한 미국 501(c)(3) 비영리 재단으로, 직원 10명 미만의 소규모 조직입니다. 매월 수십억 개의 공개 웹페이지를 CCBot으로 수집하여 페타바이트 규모의 아카이브를 Amazon S3에 무료 공개합니다. “웹 데이터의 민주화”가 미션이며, 크롤링을 파는 영리 서비스가 아니라 공공재로서의 웹 데이터를 제공하는 재단입니다.

OpenAI(GPT), Google(Gemini), Meta(LLaMA), Anthropic(Claude) 등 거의 모든 주요 AI 회사가 이 데이터를 LLM 학습에 활용해왔습니다. 다만 2025년 The Atlantic은 “Common Crawl이 유료 기사까지 수집해 AI 회사들에게 뒷문을 열어주고 있다”고 보도하여 논란이 되기도 했습니다.

확인 방법:

-

Common Crawl Index (index.commoncrawl.org): 내 도메인을 검색하면 Common Crawl이 수집한 페이지 목록과 날짜를 볼 수 있습니다

-

Have I Been Trained? (haveibeentrained.com): 이미지가 AI 학습 데이터셋(LAION 등)에 포함되어 있는지 확인하는 도구 (이미지 크리에이터에게 유용)

⑤ 행동 기반 봇 탐지

-

난이도: ⭐⭐⭐ (개발 지식 필요)

-

비용: 무료~유료

-

User-Agent를 위장하는 봇까지 잡으려면, 단순 로그 분석을 넘어 행동 패턴을 분석해야 합니다.

감지 신호:

-

비정상적 요청 패턴: 짧은 시간에 수십~수백 페이지를 순차적으로 요청

-

마우스/스크롤 없는 페이지 로드: 브라우저를 흉내 내지만 사용자 인터랙션이 없음

-

JavaScript 미실행: 단순 HTTP 요청으로 HTML만 가져가는 경우

-

동일 IP에서 반복적 전체 사이트 스캔

활용 도구:

-

Cloudflare Bot Management: 머신러닝 기반으로 위장 봇까지 탐지

-

서버 로그 + 간단한 스크립트: 요청 빈도, IP별 페이지 수, User-Agent 패턴을 집계하는 Python/Bash 스크립트로도 기본적인 탐지 가능

NOTE

개인이나 소규모 팀이라면 ①~④를 조합하는 것이 현실적입니다.

- Cloudflare 무료 플랜을 적용하면 AI 봇 트래픽 확인 + 원클릭 차단이 가능합니다

- 서버 로그를 주기적으로 점검하면 어떤 봇이 왔는지 파악할 수 있습니다

- AI에게 직접 물어보는 것만으로도 내 콘텐츠의 노출 여부를 빠르게 확인할 수 있습니다

- Common Crawl Index에서 내 도메인을 검색하면 공개 데이터셋 포함 여부를 알 수 있습니다

단, “AI가 내 데이터로 학습했는가”를 100% 정확히 증명하는 방법은 현재 존재하지 않습니다.

AI 회사들은 학습 데이터 목록을 공개하지 않으며, 모델 내부에서 특정 데이터의 기여도를 추적하는 기술도 아직 연구 단계입니다.

6. 실전 체크리스트

Step 1: AI 사용 원칙 정리

-

AI가 사용해도 되는 콘텐츠 범위 정의 (예: 블로그, 헬프센터, 공개 문서)

-

AI가 사용하면 안 되는 콘텐츠 범위 정의 (예: 유료 강의, 회원 전용, 개인정보)

Step 2: ai.txt 작성 및 업로드

-

템플릿 기반으로 ai.txt 초안 작성

-

UTF-8 인코딩으로 저장

-

사이트 루트에 업로드 →

https://도메인/ai.txt접속 확인 -

robots.txt와 모순 없는지 교차 확인

Step 3: llms.txt 작성 및 업로드

-

H1 제목 + blockquote 요약 + 섹션별 링크 리스트 작성

-

모든 링크가 실제로 열리는지 확인 (404 없는지)

-

https://도메인/llms.txt접속 확인

Step 4: 정기 업데이트 프로세스

-

이용약관·개인정보 처리방침 변경 시 ai.txt / llms.txt 동시 업데이트

-

Last-Updated날짜 항상 갱신

7. GEO(Generative Engine Optimization) 기초

7-1. GEO란?

GEO(Generative Engine Optimization)는 ChatGPT, Claude, Gemini, Perplexity 같은 생성형 AI 검색엔진에서 내 콘텐츠가 더 잘 발견되고 인용되도록 최적화하는 전략입니다.

-

기존 SEO = Google 같은 검색엔진의 순위 최적화 (키워드·백링크 중심)

-

GEO = AI가 답변을 생성할 때 내 콘텐츠를 소스로 선택하게 만드는 최적화 (문맥·신뢰성 중심)

-

유사 용어: AEO(Answer Engine Optimization), AI SEO

7-2. SEO vs GEO 핵심 차이

| 구분 | SEO | GEO |

|---|---|---|

| 최적화 대상 | Google, Bing 등 검색엔진 | ChatGPT, Perplexity 등 AI 엔진 |

| 결과 형태 | 링크 목록 (블루 링크) | AI가 생성한 종합 답변 (+ 출처 인용) |

| 핵심 요소 | 키워드, 백링크, 도메인 권위 | 문맥 이해, 정보 신뢰성, 구조화된 데이터 |

| 콘텐츠 스타일 | 키워드 중심 | 정량적·구체적·맥락 중심 |

| 사용자 행동 | 검색 → 클릭 → 사이트 방문 | 질문 → AI 답변으로 해결 (방문 불필요) |

7-3. AI가 “좋은 콘텐츠”를 판단하는 기준

-

의미 이해: 단어 자체보다 문맥과 의도를 파악

-

정보 통합: 여러 소스의 정보를 종합하여 포괄적 답변 생성

-

신뢰성 평가: 정보의 정확성과 출처 신뢰도를 판단

-

최신성 고려: 최신 정보일수록 가중치 부여

7-4. GEO 핵심 전략

- 구조화된 콘텐츠 작성

- 명확한 제목(H1~H3) 계층 구조 사용

- 질문-답변(Q&A) 형식 적극 활용

- 핵심 내용을 앞에 배치 (역피라미드 구조)

- 정량적·구체적 표현 사용

- ❌ “우리는 뛰어난 기술력을 보유하고 있습니다”

- ✅ “2024년 기준 월간 에너지 소모를 18% 절감했습니다”

- E-E-A-T 강화 (경험, 전문성, 권위성, 신뢰성)

- 저자 정보와 전문성 명시

- 데이터·통계·연구 결과 인용

- 출처를 명확히 표기

- 기술적 기반 구축

robots.txt: AI 봇 크롤링 허용 설정ai.txt: AI 사용 정책 명시llms.txt: 핵심 문서 목록 제공- 구조화된 데이터(Schema.org) 마크업 활용

- 멀티 플랫폼 존재감 확보

- Wikipedia, LinkedIn, 업계 포럼 등에서 브랜드 언급 확보

- 다양한 신뢰할 수 있는 소스에서의 인용 확보

오늘의 요약

-

크롤링은 검색엔진·AI가 웹을 읽어가는 과정이며, AI 시대에는 제어와 활용 두 가지를 동시에 고민해야 합니다

-

robots.txt(출입 규칙) + ai.txt(사용 안내문) + llms.txt(핵심 문서 안내서)로 다층 방어가 가능합니다

-

법적 강제력은 아직 제한적이지만, 명시적 의사 표시는 분쟁 시 결정적 차이를 만듭니다

-

GEO는 AI 검색에서 내 콘텐츠가 인용되도록 만드는 새로운 전략입니다

-

완벽한 보호는 불가능하지만, 아무것도 안 하는 것과 준비하는 것은 전혀 다릅니다

NOTE

NOW ー 지금 바로 시작해 보세요

- 내 사이트의

robots.txt를 열어 AI 봇 관련 설정이 있는지 확인하세요 - Common Crawl Index에서 내 도메인을 검색해 보세요

- ChatGPT나 Claude에게 “[내 사이트]에 대해 알고 있어?”라고 물어보세요

이 세 가지만 해봐도, 지금 내 사이트가 AI에게 어떻게 노출되어 있는지 파악할 수 있습니다.